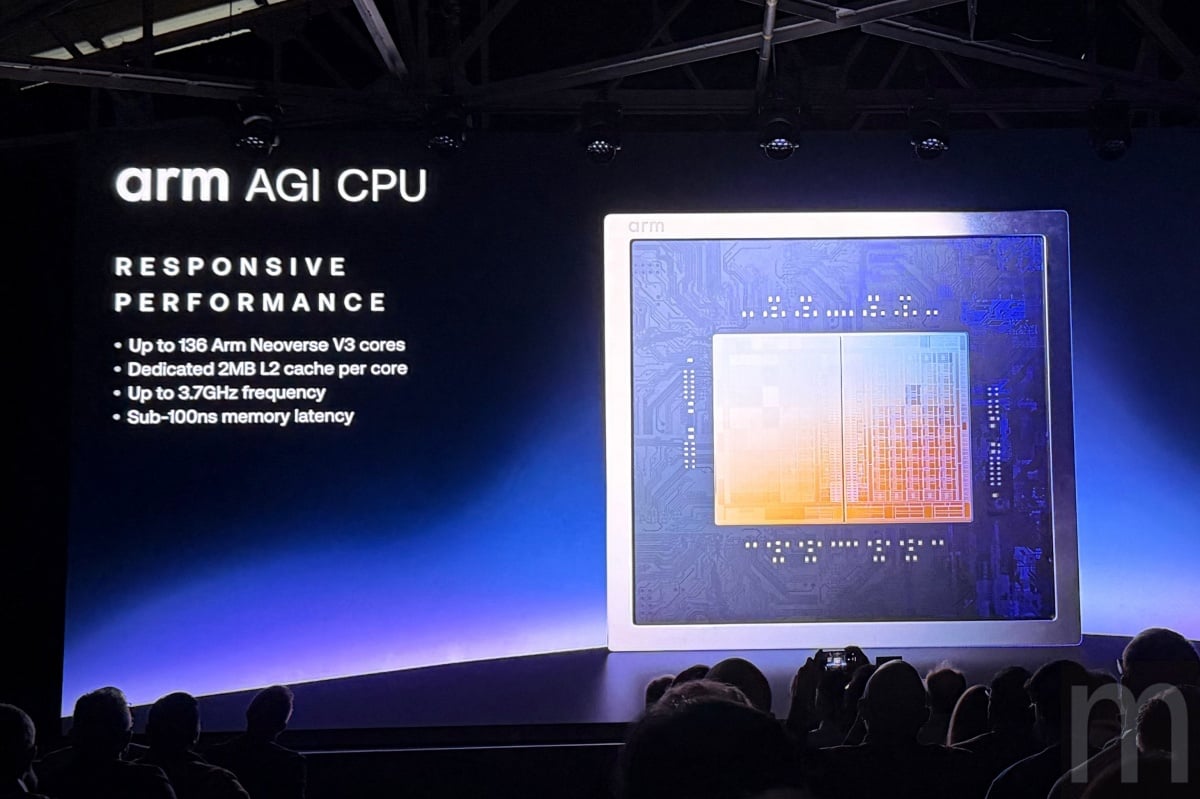

關鍵數字:隨著人工智慧代理(代理式AI)的崛起,傳統資料中心的算力瓶頸日益凸顯。為此,Arm重磅推出其首款自製晶片Arm AGI CPU,這款基於Arm Neoverse平台打造的處理器,標榜單一液冷機架最高可容納多達 45,000 個運算核心,旨在徹底解決AI時代下CPU在協調運算中的關鍵瓶頸,並將AI雲端基礎設施帶入「Arm原生」的全新紀元。

📊 數據總覽

Arm AGI CPU的設計核心在於「機架級」效率與高密度佈署,其硬體參考配置展現了驚人的算力堆疊潛力。根據Arm官方公布的配置數據,這款處理器不僅在單一節點上表現優異,更能在整個機架層級發揮超越傳統x86架構的效能。

- 1OU雙節點設計: Arm提出的標準氣冷伺服器參考架構中,每個刀鋒伺服器(Blade)採用雙節點設計,配備兩顆AGI CPU、專屬記憶體及I/O埠,單一刀鋒伺服器即可提供 272 組運算核心。

- 氣冷36kW機架: 在一個標準的36kW氣冷機架系統中,能滿載 30 個刀鋒伺服器,總計提供高達 8,160 個CPU核心,大幅提升資料中心的運算密度。

- 液冷200kW巨獸: Arm與Supermicro合作開發的極端配置,支援200kW液冷系統,單一機架可容納 336 顆Arm AGI CPU,使得總核心數得以突破驚人的 45,000 個,這在業界無疑是個里程碑。

這些數據清楚顯示,Arm AGI CPU的架構設計,能提供超越最新x86架構系統 兩倍以上 的機架運算效能,其關鍵在於Arm Neoverse V3核心卓越的單執行緒效能與更高的記憶體頻寬,確保每個執行緒都能高效完成任務。

數據解讀:代理式AI的算力挑戰

回溯過往,運算瓶頸往往受限於「人類」輸入指令的速度。然而,隨著代理式AI的崛起,這項限制已不復存在。根據Arm雲端AI事業部執行副總裁Mohamed Awad的解釋,軟體代理能夠 24小時不間斷 地自主協調任務,並與多個大型語言模型互動,進行即時決策。在這種持續運作且極度複雜的環境中,CPU的角色發生了質變。

CPU不再僅是GPU的配角,它必須同時管理數以千計的分散式任務、調度加速器、管理記憶體與儲存,甚至處理海量AI代理之間的「扇出」(fan-out)協調任務。當負載呈指數級飆升時,傳統x86架構CPU在持續高負載下,常常會面臨核心爭用與效能衰退等問題,這正是Arm決定親自投入打造AGI CPU的核心動機。

數據解讀:Arm AGI CPU的機架級優勢

為了徹底解決上述痛點,Arm AGI CPU從運作時脈、記憶體到I/O架構,皆是為支援「高密度機架佈署」與「大規模平行運算」量身訂做。Mohamed Awad強調,Arm Neoverse V3核心的 單執行緒效能 及其 更高記憶體頻寬 表現,是其超越x86架構的關鍵。這確保了每一個執行緒都能完成更多工作,並且不會像x86架構在滿載時可能發生效能崩潰的狀況。

有趣的是,Arm並未選擇在單顆CPU的絕對算力上與x86競爭,而是利用Arm架構的 高能效比 與 高核心密度,直接將戰場拉高到「機架級別」。對於雲端服務商而言,在評估資料中心建置時,他們更看重在 36kW的機櫃限制下,能塞進多少算力。在這方面,Arm AGI CPU單機櫃能提供 8,160組CPU核心,甚至多達 45,000個不降頻的核心,相較於受限於發熱與功耗的x86架構系統,具備顯著的優勢。

趨勢預測:定義未來伺服器標準

這次Arm的行動不僅僅是推出一款高效能晶片,更深層的意義在於,它打算直接定義下一代伺服器的硬體標準。為加速生態系的採用,Arm宣布推出符合開放運算計畫(OCP)DC-MHS標準尺寸的「Arm AGI CPU 1OU雙節點參考伺服器」。Arm計畫將這套伺服器設計、支援的韌體、系統架構規格、除錯框架及診斷工具,全數貢獻給OCP開放運算社群,這無疑是為整個AI產業鋪設一條名為「Neoverse」的高速公路。

目前,Arm AGI CPU已獲得包含Meta、OpenAI、Cerebras、Cloudflare等業界巨頭的採用承諾,而合作夥伴如華擎、聯想與Supermicro也已開始接受商業系統的訂單。這顯示市場對Arm在AI伺服器領域的佈局充滿信心,預示著x86陣營將面臨前所未有的嚴峻挑戰。

數據告訴我們什麼?

從上述數據與技術解析來看,Arm AGI CPU儼然是一頭徹頭徹尾的「效能怪物」,它直接瞄準傳統x86架構資料中心的機架級弱項。這不僅是Arm商業模式的重大轉型,更是對整個AI雲端基礎設施生態系的深遠影響。Arm正在收編那些無力自行開發CPU,卻又急需高效能協調器的AI新創與雲端業者。透過直接提供量產晶片與開放硬體設計,Arm正積極推動AI運算基礎架構的典範轉移,未來資料中心的算力佈局,勢必將更加傾向高密度、高能效的Arm原生解決方案。